果てしないソーシャルとAIの戦い。マルチモーダル、動画ハッシュタグ、インクルーシブ / f8 2019

今年も、Facebookのf8から大手テック企業の「開発者会議シーズン」が始まりました。

先週のFacebookに続き、今週はGoogleのI/O、MicrosoftのBuildと立て続けに開催されます。

連日のように1社あたり2-3時間のKeynoteの動画を見るのは結構骨が折れますが、それぞれR&Dに1兆円規模(Facebook $7.8B, Google(Alphabet) $16.6B, Microsoft $12.3B) のお金をかけている彼らのKeynoteは、それぞれの力の入れどころや技術開発のトレンドが分かって非常に面白いカンファレンスです。

f8は、昨年(ブログ:「何がフェイクか分からない。着実に進化するAIそしてVR :Facebook f8 2018」)同様、Day1のザッカーバーグの話は安全運転、プライバシー重視という感じで全く面白くなかったのですが、Day2で語られたAIを中心とした技術の進展の話、23億のユーザを抱えるソーシャルプラットフォームならではの有害コンテンツ対策、そして期待のVR端末、Oculus Questなどについてまとめていきます。

AIのマルチモーダル化

まず最初は、CTOのMike Shroepferから、3年前に発表された今後10年のビジョンのおさらい。

去年に続き新しい話はなし。それぞれ大きなテーマなので当たり前といえば当たり前なのですが。今回はほとんどが、技術開発三大テーマのうち、AIのお話。

これは、Facebookが日々戦っている有害コンテンツのカテゴリー。GoogleやAppleにはない、巨大ソーシャルならではの難しさを改めて感じます。

3月のNZでのテロもライブ配信されてしまったし、つい先日も人気YouTuberが未成年からMessenger経由でポルノ画像を要求していた事件など、ソーシャルならではの事件や問題は後を絶たないのが事実です。

これはFacebookに通報がある前に、どれだけの有害コンテンツを削除できているかを示したグラフ。

暴力(Violence)や児童コンテンツ(Child Safety)などは、よくやっているように見えますが、1%でも2000万人以上、つまりFacebookの日本のユーザ全てと同じくらいが有害なコンテンツを見てしまうということになるので決して小さくはない問題。

いじめ(Bullying/Harassment)、ヘイトスピーチ(Hate Speach)系は、相対的な問題なので、より検出が難しいというのがよく分かります。

これはAI研究の歴史をまとめたチャート。

一昨年、昨年にと過去のf8のブログを振り返っても、いかにAIが進化してきたかがよく分かり趣深いです。

今回は、2018年のところにある、Semi/Self Supervised Learning(半教師あり学習)、Multimodal Classifier(マルチモーダル分類)、Video Understanding(動画認識)などについての説明がありました。

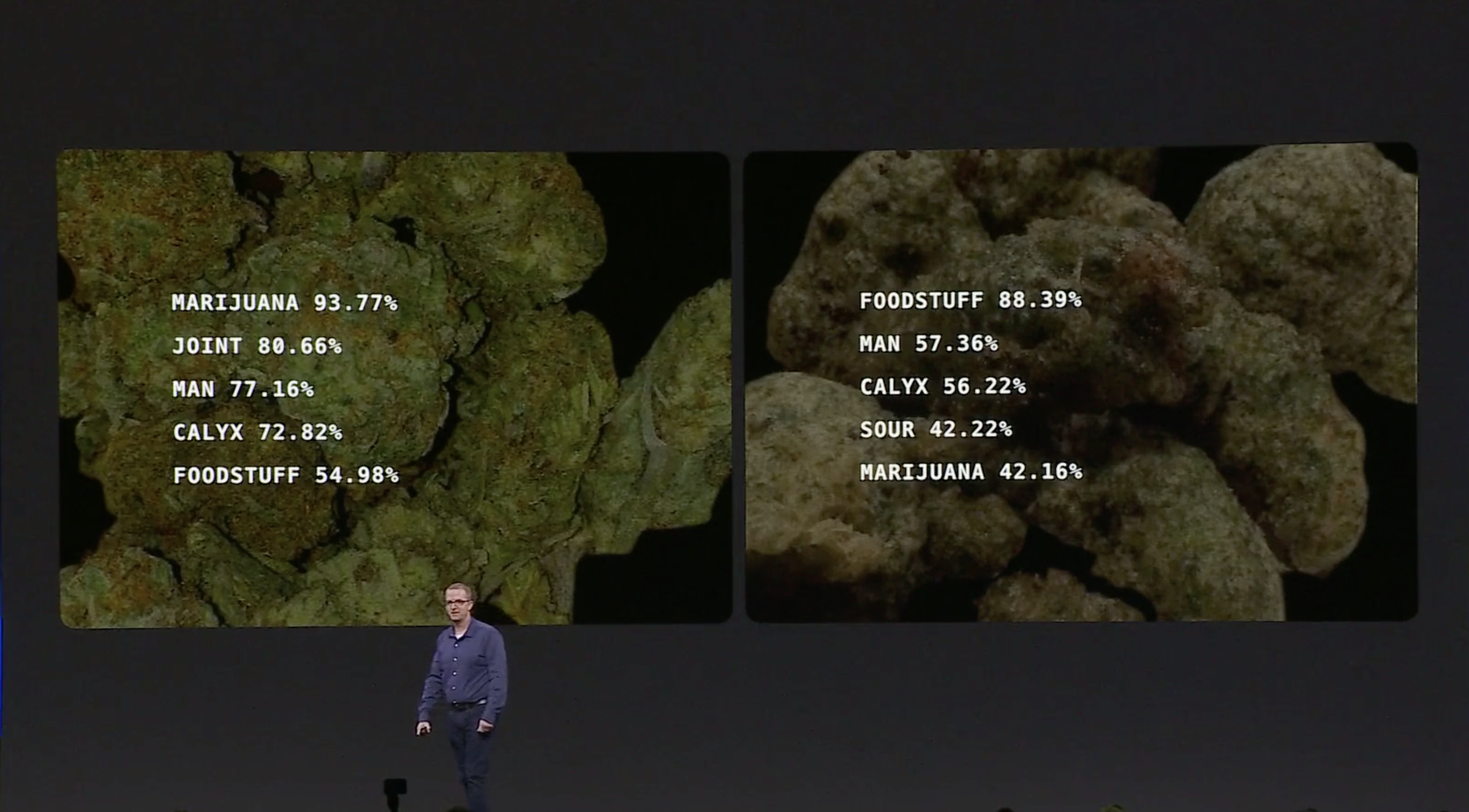

これは、画像認識がいかに進歩しているかという事例。

左はマリファナの写真で右はよく似ているブロッコリーの天ぷらの写真。人間の目でもよく見ないと違いが分からないですが、AIは明確にその違いを識別しています。

これは一見すると、お菓子か何かの箱に見えるマリファナの箱の写真。

昨年末に導入された「Nearest Neighbor Classifier」という技術を使うと、この写真のように一見マリファナのパッケージとは分からないような写真でも、類似の写真が通報されると、少ないデータでも数時間で類似の写真を有害として発見、削除できるようになったということです。

「画像を見分ける」という当初の画像認識の役割はある程度実現されており、次の戦いは「いかに早く見つけるか」ということなっているということでしょう。

これは、「マルチモーダル分類」という新しい実装の事例。

この写真自体は、単なるライスクリスピーのものですが、文章の中にマリファナを示す隠語が隠されているそうです。違法事業者側もAIの進化を理解して、あの手この手で違法薬物を販売しようとしているのですね。

写真、文字、動画単体で認識するだけでなく、複数の組み合わせ(マルチモーダル)でコンテンツ判別をするというのがこれからの取り組みということです。

いまだになくならないオレオレ詐欺の電話や高齢者によるアクセルの踏み間違い事故などと比べると、かなり高度な実装をしていると思いますが、23億ユーザのソーシャルプラットフォーム運営というのは一筋縄ではいかないものです。

Self Supervising:自分で教師データを作る

我々も日々新しいAIスタートアップからプレゼンを受けていますが、大きなカテゴリーの1つが、教師データに関連するものです。クラウドでのラベル付け(Annotation)、バーチャルシミュレーションなど、いろんな取り組みがあります。

AI自体はどんどん進化して行っても、変わらず大きなチャレンジとなっているのは大量のデータのラベル付けで、FacebookやGoogleでもいまだに人力でやっている分野です。

ここ二年くらいで勃興している新しいモデルが、人によるラベル付けをせずにいきなり大量のデータをアルゴリズムに投げ込む「Self Supervised Learning」ということです。

これはGoogleが昨年発表したBERTと呼ばれる手法で、大量の文字データをそのまま投げ込み、その一部をマスクしてアルゴリズムに予想させます。

ただ答えが分かっているので、その予想と答えをマッチしながら、アルゴリズムをトレーニングできるという発想です。

Facebookではこれを応用して、複数言語の機械翻訳のトレーニングなどに活用しているということです。特にデータが少ない希少言語などのトレーニングに有効だということです。

これまで1.2万時間かかっていたラベル付けがわずか80時間になったというのだから飛躍的な進歩です。

今月開催されるインドの総選挙のことを事例として繰り返し説明していましたが、インドのように複数の言語が使われている国で行われる選挙のような巨大イベントでは、有害コンテンツの早期発見などに大いに威力を発揮しそうです。

「背景」まで理解:画像認識

数年前「何が写っているか」を認識することにチャレンジしていたレベルから、この1-2年で「姿勢や向き」などの詳細な情報まで認識できるようになった画像認識ですが、まだ進化を続けています。

「Panoptic FPN」という新しい手法では、人物などの対象の認識だけでなく、背景の中からビルや景色などまで理解できるようになっています。もはや人間が一枚の写真から見分けられる情報を超えつつありますね。

動画も「#ハッシュタグ」で進化

静止画からは、背景も含めてかなりの情報が瞬時に理解できるようになりました。

一方動画は、長さ、動き、音声、様々な情報が組み合わさっているため、まだまだチャレンジがあるようです。

最新の「Salient Sampler」という手法では、まず動画をざっとスキャンして、大事そうな部分だけを抜き出してから認識にかけることで、速度や精度を向上することに成功しているということです。

去年から、FacebookではInstagramなどでパブリックに公開されている画像のハッシュタグを使い画像認識の向上に取り組み始めていますが、今年からそれを動画にも活用し始めたということです。

これまで6500万の動画のハッシュタグを使い、1万ものアクションが認識できるようになったそうです。

動画やライブ配信の認識はかなり難しい問題だとは思いますが、テロや戦争などをライブ配信という問題もあるので、ぜひ進化を期待したい分野です。

「インクルーシブ」なAI

Day1の発表の中で、おっと思ったのがPortalを世界展開するというニュースです。

Amazon Echo、Google Homeの後塵を拝していてあまりニュースを聞かないなと思ったのですが、引き続き積極展開していくようです。

そのPortalの1つの特徴は、AIを使って、人がいるところを追いかけてフォーカスを当て続けることができるという点。これは確かに面白いかもですね。今更ながらに二台注文してみました。

そこで登壇していたLade Obamehintiという黒人の女性エンジニアが、開発中に自分が喋ってもPortalは自分に気づかずに、白人の男性の同僚の顔にフォーカスを当ててしまったというエピソードを紹介しました。

そこで紹介されたのが「インクルーシブなAI」というコンセプト。

これまで見てきたように大いに進化している画像認識技術ですが、今後は当然肌の色、性別、年齢問わずにちゃんと認識する必要が出てくるというわけです。これが、「インクルーシブなAI」。

顔の形やサイズを認識して、様々なステッカーを載せるAIアプリ。

手を認識してエフェクトを載せるなんていうアプリもあるので、様々な色、形の手に対応する必要があります。

自動車の自動運転などを考えるとAIのインクルーシブネスは必須なのですが、いち早く実用が進んでいるFacebookなどでは、すでに現実的な要求となっているということですね。

Oculus Quest:VR普及への期待

最後は、VRです。

5年前に、いきなりFacebookがOculusを$2Bで買収し、一気に盛り上がったVR業界。しかしながら、その後は思ったように端末が普及をせず足踏み状態が続いています。

今回、ついにFacebookがプレオーダーを開始したのが、 大きな期待がかかるOculus Questです。

Oculus Questの主な特徴は以下の通りです。

- 安価 $399

- オールインワン PCやスマホと接続不要

- トラッキング 目の動きや体の動きをトラッキング

値段はそこそこに抑えて、コンピュータと繋ぐ必要のないオールインワンのVRヘッドセット。再来週から手元に届きますが、触った人の評判はかなりいいので期待しています。

これは、まだ実装されていませんが、テスト段階の「全身のトラッキング」について。

体の骨格、筋肉を詳細にシミュレーション(動画の2:37-)することで、全身を使ったバーチャルサッカー(動画の6:19-)が実現できています。

現在運営しているSPORTS TECH TOKYOでもVR/ARは1つの注目分野なので、スポーツにも使えそうなこうした新しいブレークスルーには期待したいです。

FacebookがVRのコアと期待しているのが「ソーシャルVR」です。

リアルなソーシャルと同様に、ソーシャルVRでも様々なハラスメント的なことは起こるということで導入されたのが「Safety bubble」。

そのエリア以上は近づけないというバーチャルなバウンダリーみたいなものです。ちょっと体験してみないとイメージがわきませんね。

さらに嫌な経験をした場合に、両手でサムダウンをすることで、そのユーザをブロックできるという機能も追加されたということです。

こういう機能が実用的になるくらいに、ぜひQuestが普及して欲しいと心から願っています。

再来週にQuestが届いてからは、私もしばらくはVRの世界で多くの時間を費やしたいと思うので、ぜひVRでお会いしましょう。

以上、2019年のf8のまとめです。

来年は、もう少し問題が落ち着いて、未来の技術について語って欲しいなと期待しています。ARメガネとかBrain Interfaceとか。